Google 的 AI 图像工具 Nano-Banana。

不仅免费能用,关键是它家工具的体验通常都很“顺手”

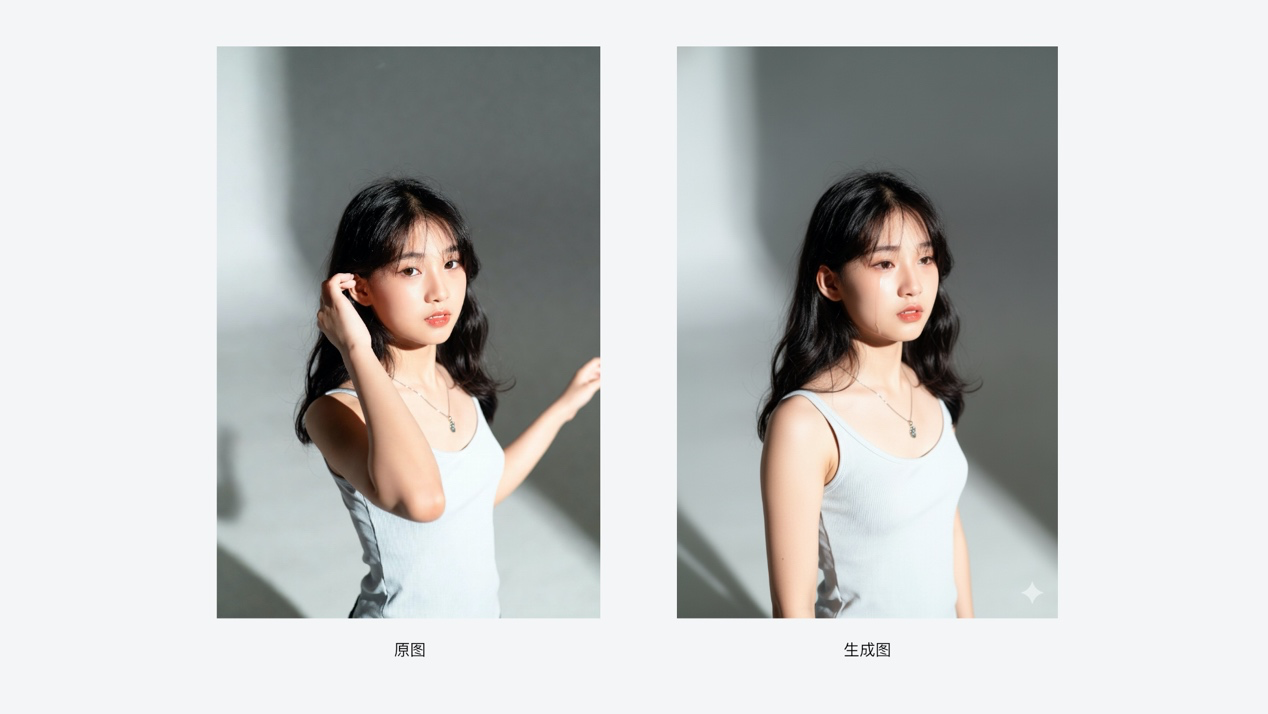

Nano-Banana 最强的一点,是“图像编辑时的主体一致性”。

懂 AI 图像的人都知道,这其实踩中了一个行业公认的大痛点:

你给它原图,妆容不丢、头饰不掉、服饰细节保留得很“丝滑”,

又能让新背景、新元素自然贴合进去,几乎不需要返工。

“Nano Banana” 是 Google 开发的人工智能图像生成与编辑工具。

它最初是该模型在发布前测试时在 LMArena 上使用的代号,目的是让社区能够在不知道其真实身份的情况下评估它在实际场景提示上的表现。

现在,这个工具已经作为 Gemini 系列 AI 产品的一部分正式公开发布,

编辑图像:上传照片,然后让 AI 更改背景、替换物体或添加新元素。

简单来说,Nano Banana 就是 Google 顶级的 AI 图像生成和编辑模型。

以前我们生成一张图,想改就得重新生成、重新写提示词,几乎没有“记忆”。

而 Nano Banana 支持在同一张图上 多轮对话编辑

你可以连着聊、连着改,它能记住你要的风格、主体细节。

写提示词时,建议使用以下六大元素来构建清晰的指令:

构图: 观察角度和景别(如:从下往上的低角度拍摄,全身照)。

动作: 赋予主体的动态和意图(如:他单膝跪地,低头沉思)。

场景: 搭建环境背景(如:身处于一个古老而残破的战场)。

风格: 决定艺术表现形式(如:写实风格,黑暗奇幻,电影级光效)。

指令: 最后的格式或技术微调(如:长宽比、排除的元素)。

Google 官方指南的核心原则是 “描述场景,而非罗列关键词”。

• 照片级真实感: 像摄影师一样思考,提及相机角度、镜头类型(如 85mm 人像镜头)、光线和精致细节。

• 精准文字渲染: 明确写出要渲染的文本内容、描述字体风格和整体设计,模型非常擅长处理文字。

• 产品摄影: 使用专业的影棚光描述(如:三点式柔光箱设置),并指定焦点清晰对准的关键细节。

• 使用专业术语: 使用如“广角镜头”、“微距拍摄”、“低角度视角”等摄影术语可以提升构图的准确性。

• 多轮迭代: 如果进行多轮编辑后细节开始模糊,建议使用最新生成的、最满意的图像作为新的基准图,并开启新的会话

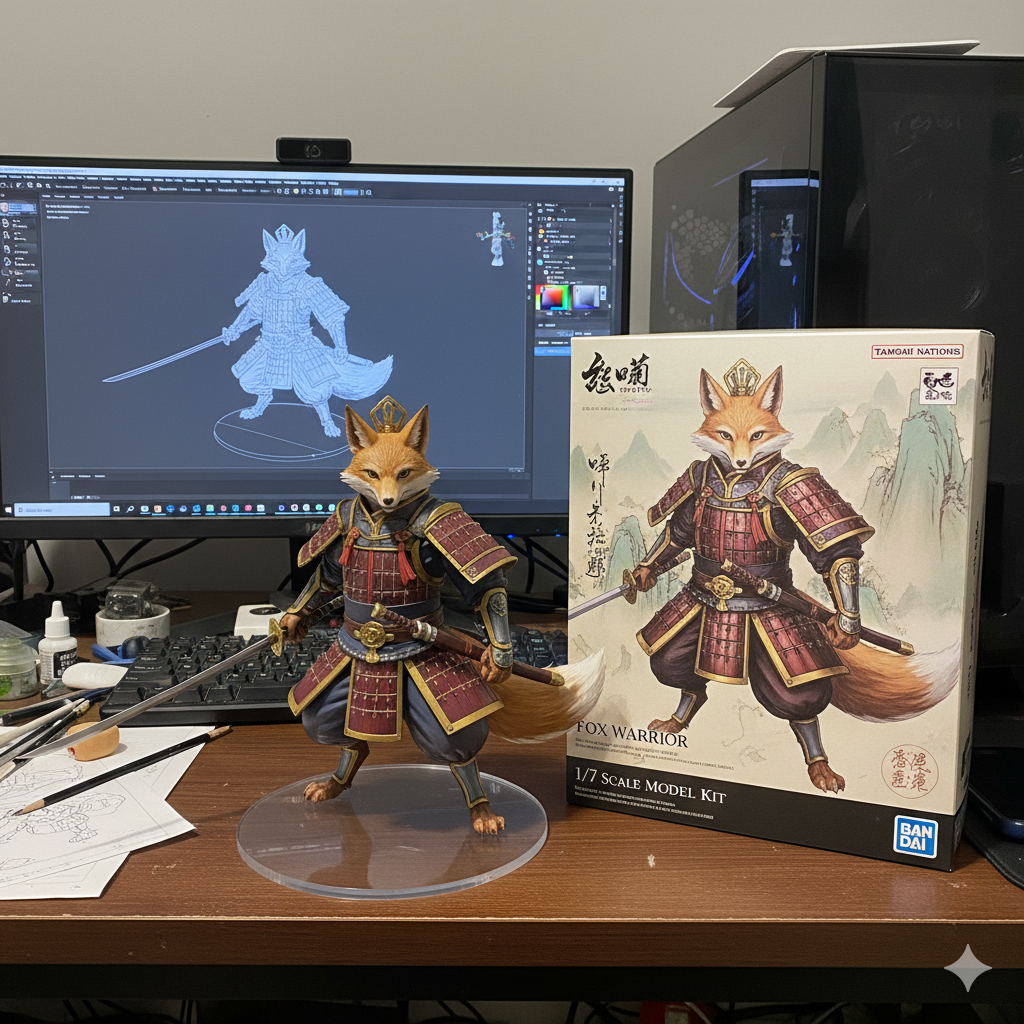

制作了一个1/7比例的商业模型,置于真实世界的电脑桌上。模型底座是圆形透明亚克力板,无文字。电脑屏幕显示模型的Brush建模过程。屏幕旁放置一个Bandai风格的玩具盒,盒上印有原始画作,盒子是2D插画风格,与画作保持一致。

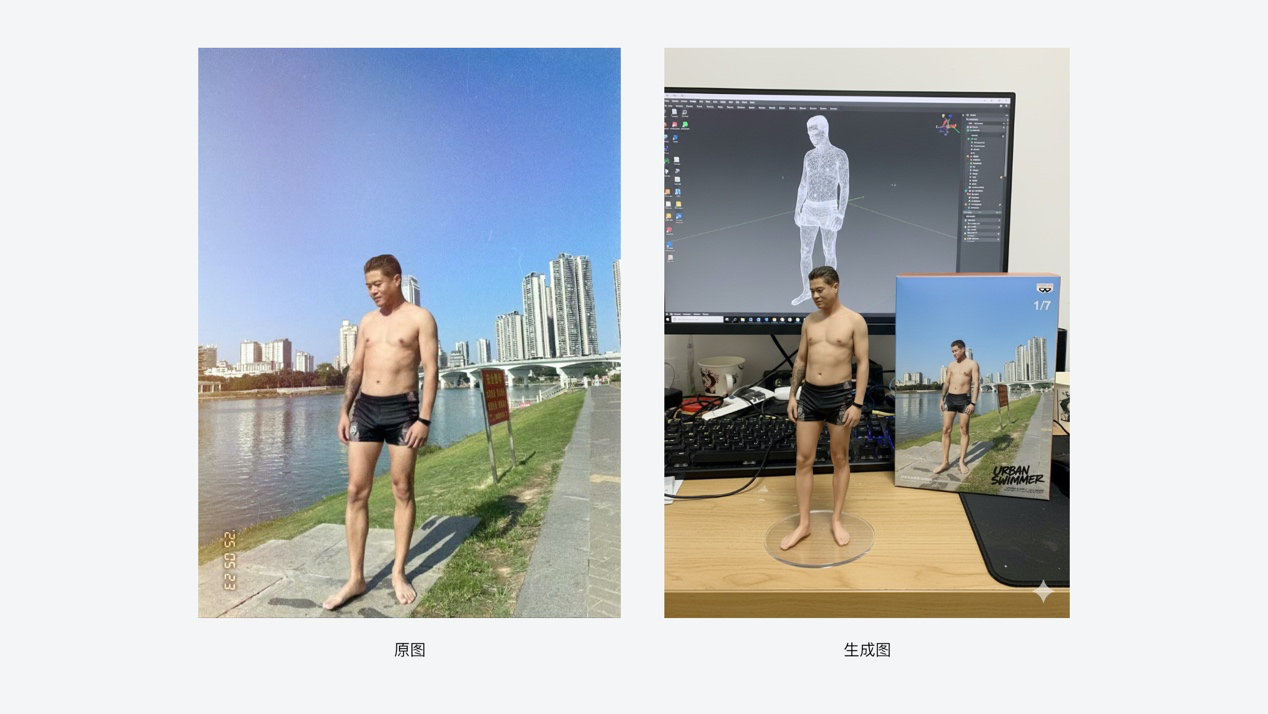

根据照片中的人物,制作了一个1/7比例的商业模型,置于真实世界的电脑桌上。模型底座是圆形透明亚克力板,无文字。电脑屏幕显示模型照片中的人物建模过程。屏幕旁放置一个照片中的人物风格的玩具盒,盒上印有原始照片,与画作保持一致。

动作一致、表情一致、头饰一致、甚至手上的小配饰都能精确还原。

“照片中的女孩,帮我改为睁开着的明亮的眼睛,表情开心 ”

眼睛的光感、表情的变化、甚至周围水面的光影也会被轻微调整,让整体更协调。但人物细节和感觉不会乱。

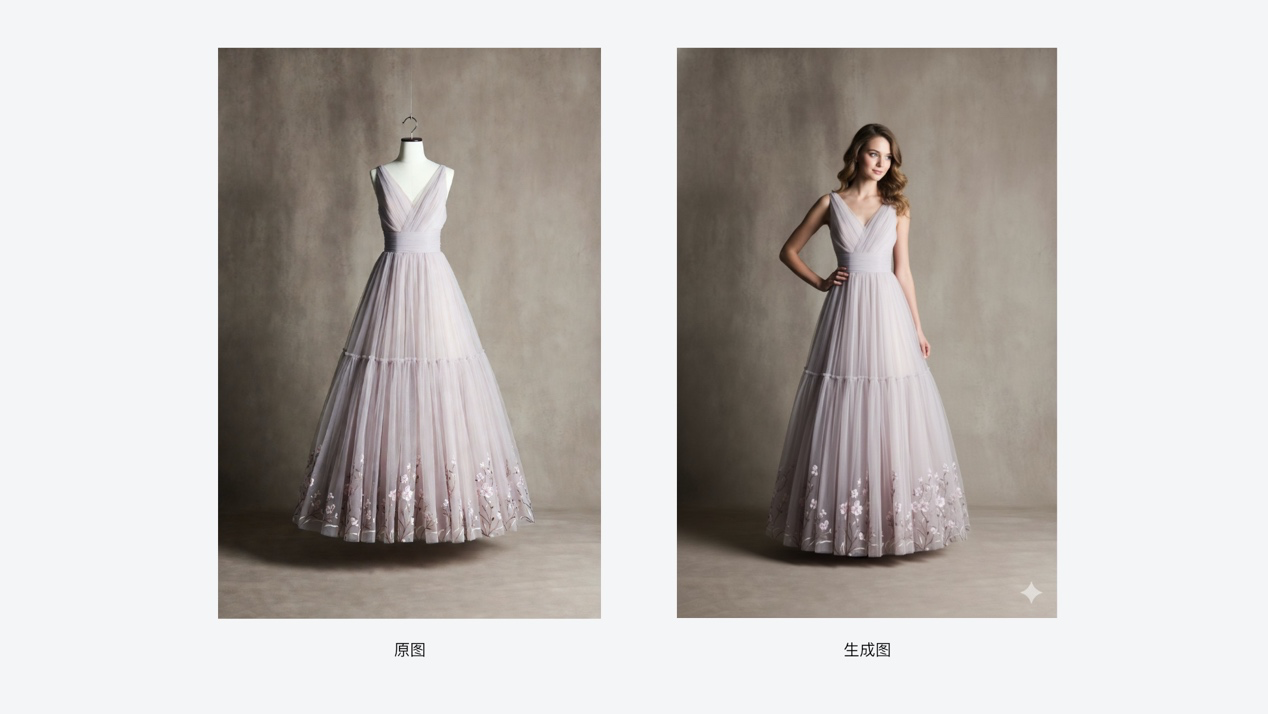

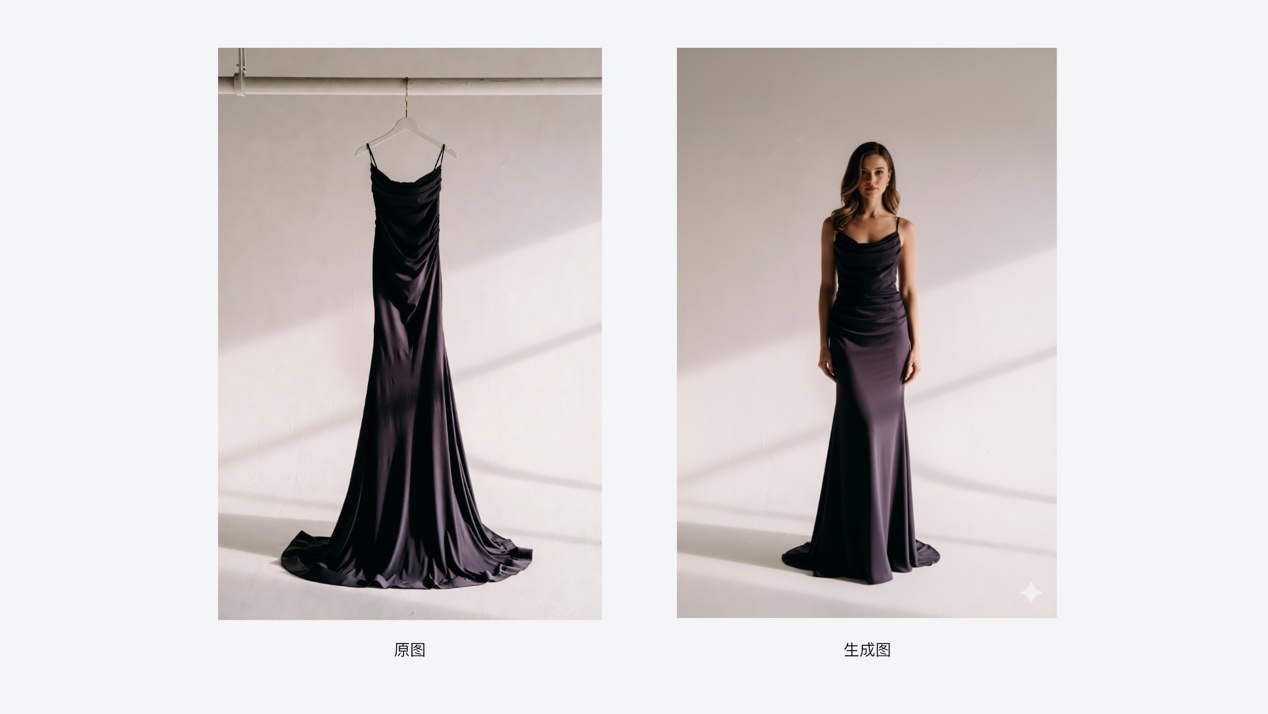

让人物穿上这个图的连衣裙,细节,款式,颜色等等保持不变

这时 Nano Banana 就能发挥它的“氛围重塑”能力。

人物照片转换为赛博朋克霓虹风格,背景为未来都市夜景,高饱和霓虹

动作完全没改,五官也不变,但灯光、反射、色彩氛围都会自动与新背景匹配。

那种“光打在脸上却不违和”的精准感,就是它厉害的地方

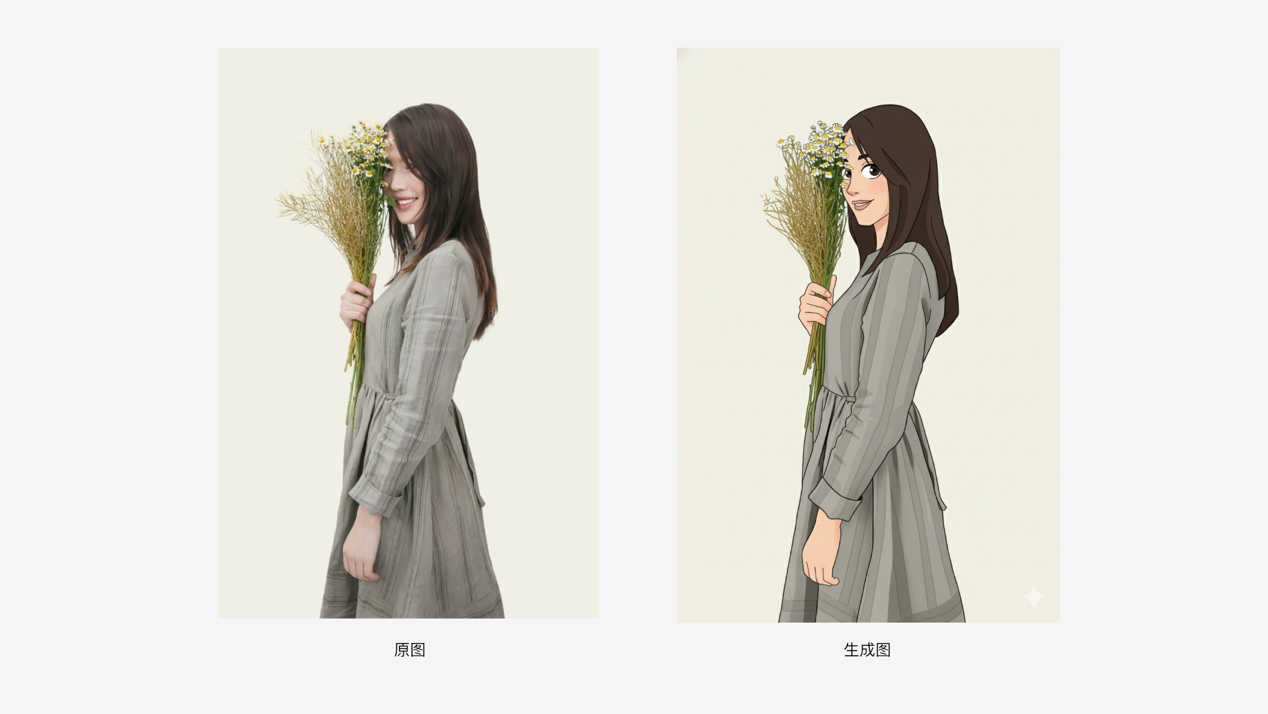

把这个照片里面的人物卡通化,用马男动画风格,要求矢量

不仅动作还原、手部细节保住,甚至连脸上的细微表情,都能完美迁移到插画里。

上面这 5 种玩法,是目前大家最常用、最稳定的方式。

这些逻辑也能套到产品图、电商图、潮玩、头像、海报等任意场景里。

比如先做手办,再换背景,再改表情,再加插画风格……

只要指令够清晰,Nano Banana 基本都能照着你的想法走。

听说 2.0 版本最近短暂上线过一下,马上又被撤了。